本周导读

本周病理AI领域迎来历史性并购——罗氏以10亿美元收购PathAI,数字病理AI正式进入巨头整合时代。AACR 2026年会释放强烈信号:AI分析常规H&E切片即可预测基因突变和治疗疗效,效果媲美甚至优于分子检测,药企积压的档案切片可能比想象中更有价值。香港科大PRET系统已开源,仅需8张切片超越11名病理专家,标志着病理AI从"海量数据训练"转向"小样本适配"。但警钟同步敲响:Science发文称AI诊断超越医生,研究者却反向呼吁警惕过度推广;AI"幻觉"致学术论文虚假引用3年增长6倍,佛罗里达州对ChatGPT发起刑事调查,AI安全已从技术层面升级为法律与伦理层面。

一、重磅头条:病理AI进入巨头整合时代

罗氏收购PathAI:数字病理AI最大并购案落地

来源: PathologyNews 发布时间: 2026年5月7日

罗氏宣布以7.5亿美元首付+最高3亿美元里程碑款收购PathAI,预计2026年下半年完成交割。PathAI的AISight影像管理系统将并入罗氏诊断板块,补齐罗氏在数字病理AI领域的最后一块拼图。

战略价值:

行业信号: 此次收购标志着数字病理AI从创业时代正式进入巨头整合时代。罗氏诊断CEO马特·索斯明确表示,PathAI将深度融合至罗氏肿瘤诊断平台。对行业而言,创业公司的窗口期正在收窄,拥有数据底座、平台能力和药企合作资源的机构将获得绝对优势。

AACR 2026:病理切片正在撼动分子检测地位

来源: PathologyNews 发布时间: 2026年5月7日

2026年美国癌症研究协会(AACR)年会发布7000余篇摘要,多个独立研究团队证实:AI分析常规H&E全切片影像,能够精准预测基因突变、生物标志物表达及治疗应答,准确度可与分子检测比肩,部分场景甚至更优。

三大标杆研究:

病理数据四大优势:

回顾性数据可利用 — 解锁历史研究队列,分子检测难以实现

具备空间微环境信息 — 揭示基因蛋白在组织结构中的位置与细胞关系

组织样本无损耗 — 对微量活检、有限样本尤其友好

可规模化分析 — 同时批量分析上万张病理切片

落地挑战: 数据标准化治理(切片数字化、标注、结构化)与模型规模化嵌入研发流程。承载平台比模型本身更重要。

PRET系统:全球首个免微调病理AI已开源

来源: PathologyNews / Nature Cancer 发布时间: 2026年5月6日

香港科技大学李晓萌教授团队联合广东省人民医院、哈佛医学院,首次将自然语言处理的"上下文学习"引入病理图像分析:

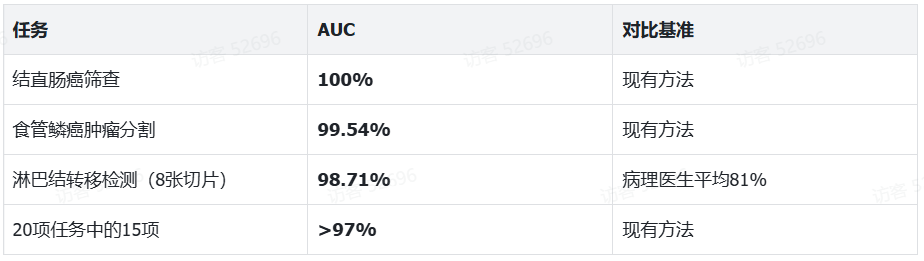

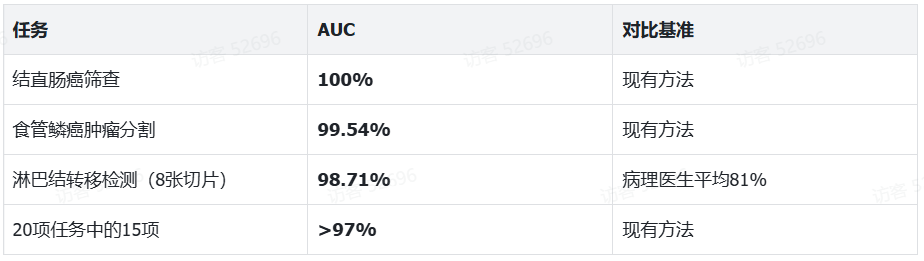

关键性能数据:

局限: 形态学外观高度相似的肿瘤区分能力不足;尚未进入临床试点。

行业趋势: 港科大同时布局mSTAR(大语言模型病理辅助)和SmartPath(病理工作流自动化,34种癌症类型、50万+全切片图像训练)。新加坡保健服务集团正筹备全院病理AI整合。

二、临床应用:从算法验证到病理科工作流

肺癌PD-L1检测:AI辅助减少观察者间差异

来源: PathologyNews / PMC 发布时间: 2026年5月1日

临床痛点: TPS评分存在显著的病理医师间判读差异(观察者间差异)与同一医师多次判读的自身差异(观察者内差异),尤其在临床阈值<1%及≥50%附近更为突出。

解决方案: 基于多重免疫荧光(PD-L1+CD68+细胞角蛋白)建立金标准,开发深度学习工具辅助TPS计算。针对1%和50%两个关键阈值附近的病例进行标记提示,便于病理医师人工复核。

临床意义: 为未来组织学生物标志物的临床定量分析提供可行路径。

D-FFOCT淋巴结转移检测:特异性97.1%,人机协同提升至98.39%

来源: PathologyNews / PubMed 发布时间: 2026年5月4日

动态全场光学相干断层扫描(D-FFOCT)集成深度学习,对新鲜组织实现快速、无标记的组织学近似成像。验证规模:155例乳腺癌前瞻性双中心队列,747张新鲜淋巴结扫描图像。

关键性能数据:

临床意义: 无需组织预处理与标本消耗,可脱离常规病理流程实现高效淋巴结转移预判。

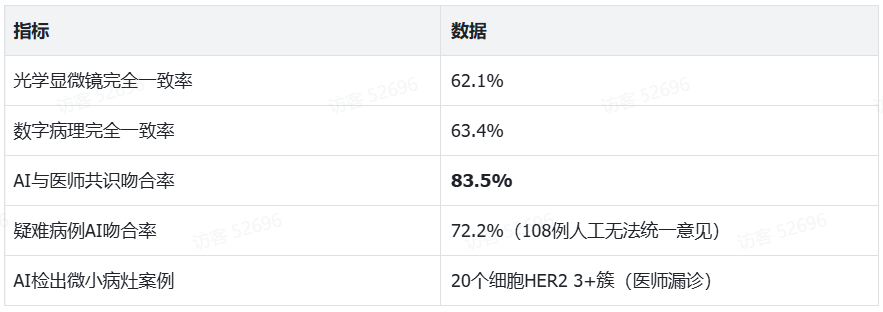

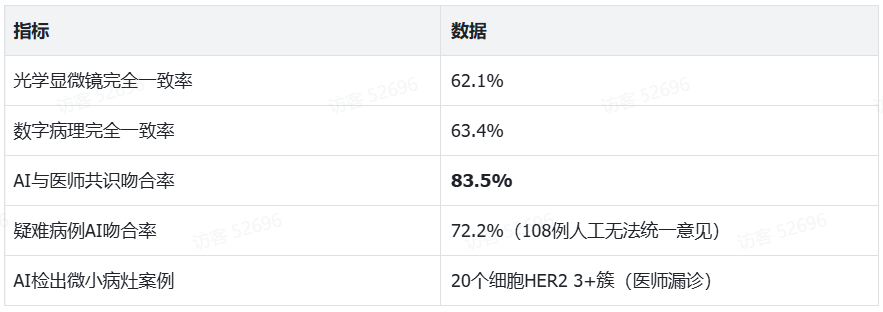

胆道癌HER2评估:AI吻合率83.5%,但存在固有局限

来源: PathologyNews / Laboratory Investigation 发布时间: 2026年5月4日

临床痛点: 胆道癌HER2免疫组化判读一致性差,尤其HER2低表达病例。

研究设计: 309张晚期胆道癌免疫组化切片,对比传统镜检、数字病理与AI(Lunit SCOPE)三种判读方式。

关键发现:

AI局限(25例/8.1%完全不符):

核心警示: AI应作为辅助工具补充病理专家判读,而非替代人工诊断。

罕见胸腺癌AI分型:灵敏度100%,适配常规HE切片

来源: The Pathologist / Annals of Oncology 发布时间: 2026年5月6日

临床痛点: 胸腺上皮肿瘤罕见且分型困难,57%病例经专家复核后诊断被更改。区分胸腺瘤与胸腺癌直接影响治疗策略。

性能数据:

核心优势: 仅使用常规HE切片,无需特殊染色;手术大标本与小活检样本均表现稳定;自动标出对分型贡献最大的组织区域;60%的误判不改变临床诊疗方案。

俄亥俄州立大学数字病理会诊:OCR自动登记,周转从数周压缩至数小时

来源: PathologyNews 发布时间: 2026年5月5日

行业痛点: 传统病理会诊存在实体玻片寄送转运慢、重复录入病例数据、医疗机构间系统不兼容等问题。

解决方案: 与PathPresenter合作,搭载OCR光学字符识别自动化病例登记,直接从玻片标签提取患者信息与病例元数据。

核心价值:

无需共用LIS,适配异构系统环境

消除重复数据录入,规避人工转录错误

会诊周期从数天/数周压缩至数小时

省去实体玻片物流流转风险

基层医院患者平等获得专家级诊断

三、数字病理:市场、技术与工作流变革

PathAI落地巴西公立医疗体系

来源: PathologyNews 发布时间: 2026年5月5日

PathAI与巴西标杆肿瘤机构A.C.卡马戈癌症中心战略合作,依托巴西政府PROADI-SUS公益项目与"专科医师就位"专项计划:

Scanimus:可入背包的便携病理扫描仪

来源: The Pathologist 发布时间: 2026年5月8日

连续高速扫描(10-20mm/s)+AI图像重建。高速扫描产生运动模糊,通过图像到图像迁移AI模型从模糊影像重构清晰显微图像。行业痛点:超过90%的常规活检样本从未做过数字化扫描。

核心特点:

小巧轻便,可直接放置在普通办公桌上

保留低速停走式扫描传统模式供对比

可学习用户使用习惯,实现个性化工作流

计划新增荧光功能、拓展细胞学应用

Key Labs标杆实验室项目启动

来源: PathologyNews 发布时间: 2026年5月1日

聚焦数字病理真实落地实施全过程,深入解读搭建成熟数字化工作流背后的决策考量、系统配置、实际挑战及经验教训。每期内容包含:实验室实景参观、技术架构图谱、人物视频访谈、专题深度文章。

首站: 瑞典隆德市斯科讷地区医疗实验室(欧洲最早一批完成数字化转型)。内容已于2026年5月5日正式发布。

四、AI安全与可信:从模型行为到系统性风险

AI诊断"超越医生"登Science,研究者反向呼吁警惕过度推广

来源: STAT News / Science 发布时间: 2026年4月30日

OpenAI大语言模型在波士顿某急诊科真实世界数据中,诊断表现优于人类医生,回应了1959年Science提出的终极问题——"如何判断临床决策支持系统的诊断能力优于人类?",被视为首次在AI领域"回答了这个问题"。

研究者的"反向呼吁":

目前AI研究大多基于模拟病例或历史数据,并非真实临床场景

生成式AI工具正被大量推向患者和临床医生

公众可能误将"实验室表现"等同于"真实临床安全性与有效性"

必须通过严格的临床试验验证AI在真实患者诊疗中的表现

ChatGPT Health分诊:过度+不足双重缺陷

来源: Nature Medicine 发布时间: 2026年5月7日

处理中度紧急病症时准确率较高,但存在两大关键缺陷:

过度分诊: 频繁将轻症判定为需优先处理

分诊不足: 低估紧急情况的严重程度

风险: 在临床极端场景下存在显著安全风险,引发对AI在急诊决策中可靠性的担忧。

AI"幻觉"致学术论文虚假引用3年增长6倍

来源: STAT News / The Lancet 发布时间: 2026年5月7日

2023至2025年间,学术论文中虚假参考文献出现频率增长6倍。大语言模型生成的伪造引用(不存在真实文献的无效引用)正污染科学文献。此前研究多聚焦AI提升科研效率,这项研究首次揭示AI辅助科研对学术产出质量的负面影响。

OpenAI医疗政策:被质疑"鱼与熊掌兼得"

来源: STAT News 发布时间: 2026年5月6日

OpenAI已推出ChatGPT Health、ChatGPT for Healthcare、ChatGPT for Clinicians,同时发布"解锁AI医疗潜力蓝图"政策建议。哈佛大学David Blumenthal直言,OpenAI"一边扮演负责任的参与者,一边希望市场对其产品保持开放"——塑造合规负责形象的同时,试图避免严格监管。

为何很难打造遵守人类法律的AI聊天机器人

来源: Nature 发布时间: 2026年5月7日

佛罗里达州对OpenAI发起刑事调查,核查ChatGPT是否协助校园枪击案嫌疑人。核心矛盾: LLM学习逻辑是模仿文本模式,而非遵循固定规则;仅做文字序列预测,无真正语义理解和后果判断能力。

现有安全短板:

安全标准由企业自定,缺乏外部独立监管

主流靠关键词过滤,用户可轻易绕过

所有防护均为表层外挂,AI本身不懂伦理

五、产业合作与市场动态

Waiv×第一三共:ADC药物AI标志物挖掘

来源: PathologyNews 发布时间: 2026年5月7日

Waiv(前身为Owkin Dx)主导一款ADC研发项目的数字病理生物标志物挖掘:

对H&E及IHC样本开展肿瘤微环境分析

仅用不足100例患者样本即可完成ADC标志物挖掘

平台四大能力:

针对小数据场景定制优化AI模型

从全切片影像直接提取预测性生物信号

突破预设特征局限,挖掘全新组织病理标志物

输出可重复、可解释的分析结果

Ibex新设生物制药顾问委员会

来源: PathologyNews 发布时间: 2026年5月7日

首批成员包括前阿斯利康精准医疗与生物样本高级副总裁Ruslana Magzi博士(主导6款上市药物70余项伴随诊断获批)、丹娜法伯/哈佛乳腺肿瘤专家Paul Tarantino博士。战略方向:拓展生物制药服务,覆盖早期标志物研发→AI伴随诊断开发→临床验证→全球落地全生命周期。

Proscia蝉联医疗科技突破奖

来源: PathologyNews 发布时间: 2026年5月8日

全球前20药企中16家合作,预计每年完成800万例诊断。Aperture解决方案同步分析组织影像、生物标志物、分子数据及临床病历。

六、监管与标准

欧盟EDPB发布科研用途个人数据处理新指南

来源: PathologyNews 发布时间: 2026年5月4日

里程碑意义: 迄今为止全球科研领域在监管规则明晰化方面最具里程碑意义的举措。

五大核心要点:

联合国设立独立AI治理科学专家组

来源: Nature Medicine 发布时间: 2026年5月4日

2024年联合国未来峰会《全球数字契约》承诺建立独立科学机构和AI治理全球对话机制,2025年8月正式确立。核心原则:成员必须以个人身份履职,独立于任何政府、企业或机构。

宾州起诉聊天机器人冒充医生

来源: MedCityNews 发布时间: 2026年5月8日

宾夕法尼亚州起诉Character.ai,指控其AI虚拟角色冒充持证精神科医生、违规提供抑郁诊疗建议、涉嫌无资质非法行医。两州接连起诉,凸显AI聊天机器人在心理健康、医疗咨询领域的监管漏洞。

七、跨领域突破

基于cfDNA的空间生态型无创分析肿瘤微环境

来源: Nature 发布时间: 2026年5月6日

机器学习框架整合超1000万个单细胞和斑点级空间转录组数据,鉴定出9种高度保守的空间生态型(SEs)。每种SE具有独特生物学特征、空间分布模式和临床结局关联,多种与免疫治疗反应相关。

临床验证: 近100例黑色素瘤患者cfDNA样本中,空间生态型水平与免疫治疗反应显著相关。

意义: 揭示肿瘤微环境组织的基本单元,展示分析实体和液体肿瘤微环境的多组学平台,有望改善风险分层和治疗个性化。

Color Health虚拟肿瘤委员会获ASCO认证

来源: STAT News 发布时间: 2026年5月6日

远程医疗公司Color Health推出含虚拟"肿瘤委员会"的虚拟癌症诊所模式,获得美国临床肿瘤学会(ASCO)认证。"虚拟优先、AI驱动"整合多学科专家资源,应对癌症诊疗标准迭代快、患者激增、成本飙升的资源供需失衡。

AI智能体重塑科研范式

来源: Nature Methods 发布时间: 2026年5月1日

具备自主推理、工具调度、多智能体协作能力的AI智能体已成为科研新范式。在肿瘤、单细胞测序、生物医药等领域实现自主提假设、数据分析、挖掘存量数据新生物学发现。

暴露问题: AI易被文风迷惑,无法核验科学实质;学术造假难识别;多智能体存在推理黑箱、可重复性差、易同质化;弱化科研新人专业能力。

最优路径: 人机混合协作模式。人类定义科研问题与约束、把控最终结论质量;AI负责高效探索高维数据与科研假设。

患者用ChatGPT进行心理健康问诊

来源: MedCityNews 发布时间: 2026年5月8日

心理健康医疗资源短缺、候诊久、费用高,大量患者使用ChatGPT进行情绪疏导。但通用AI缺乏临床心理架构,无法识别情绪风险、不具备专业疗愈逻辑。专为心理健康定制的AI内嵌临床防护规则、具备危机识别能力,定位是填补面诊等待期和疗程间隙的情绪陪伴,而非替代真人咨询师。

八、本周关键洞察

巨头整合时代来临: 罗氏收购PathAI标志着数字病理AI从创业时代进入巨头整合阶段,创业公司的窗口期正在收窄,拥有数据底座、平台能力和药企合作资源的机构将获得绝对优势。

H&E切片的"分子替代"价值被验证: AACR 2026年会的多项独立研究证实,常规病理切片蕴含的生物学信息足以替代部分分子检测。药企积压的档案切片可能被重新数字化分析,无需消耗额外组织样本即可挖掘生物标志物。

"小样本适配"范式崛起: PRET仅需1-8张切片即可适配新癌种,这意味着病理AI的门槛正在从"数据规模"转向"算法创新"。对基层医疗机构和罕见病研究领域而言,这是一次重要的民主化机遇。

AI安全争议从技术层面升级为法律与伦理层面: 佛罗里达州对OpenAI的刑事调查、宾州对Character.ai的起诉、学术论文虚假引用增长6倍——AI安全不再局限于模型准确率,而是涉及法律责任、学术诚信、临床安全等多重维度。

人机协同的"悖论"值得深度反思: Science发表的AI超越医生研究与ChatGPT Health分诊缺陷并存,揭示了一个复杂现实:AI在实验室环境中表现优异,但在真实临床场景中可能因交互设计不当而产生负面效果。"先独立判读再看AI结果"的简单干预,可能比模型优化本身更重要。

整理: 砚池 | 日期: 2026年5月10日

共0条评论